三:各种名词解释

采样率:

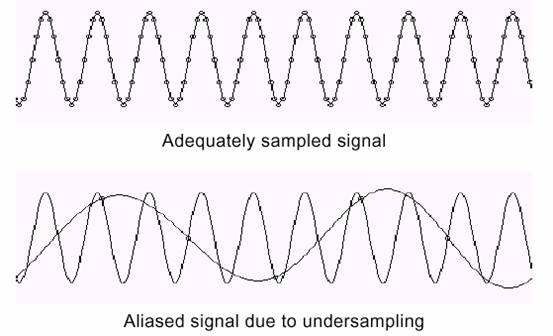

采样的频率,以hz赫兹为单位,是按照一定时间间隔,采集一种连续变化信号的状态值。采样结果是一组点状值,用于描述采集目标的信号变化。一般用于描述声音的数字化采集质量。声音本身是一种模拟信号,要采集为数字信号,就需要以数字描述声音在各个时间点的情况,包括频率,响度等等。常见音乐CD一般是44.1Khz或44.8Khz的采样率。更高的专业录音设备有96Khz或128Khz采样率的。但是一般人耳很难区分高于44.8Khz采样的声音差异。说人话就是一般人耳分不出96Khz和44.8Khz采样的区别。而对于老旧的磁带或低码流的Mp3音乐,人耳是可以听出差别的。所以目前大多的音乐和电影采用的采样率都是44.8Khz或48Khz,个别高质量音乐采用96Khz,甚至128Khz采样率。

Stereo立体声:

顾名思义就是有立体方位感的声音。形成立体声至少需要2个不同位置音源实现,当然不限于2声道。2个音源会让人耳判断声音在一个平面上的方向,多个音源让人耳感觉声音在一个立体空间的布局。但是普遍说的立体声是区别于单声道而言的,所以一般说立体声就是指2声道(或2.1声道)。

surround环绕声:

很显然,环绕声属于上边所说的立体声范畴,属于立体声概念的一个子集。环绕声指多于2个声道的音源,一般民用的环绕声设备是5.1声道起步,直达商业影院的24声道。环绕声的多个声道不仅仅是控制每个频率声音的强弱,还有延迟和回音效果,所以可以通过数学算法,在很小的房间内,实现巨大空间(几千人的大剧场)的音响效果。

PCM/LPCM:

PCM脉冲编码调制,和LPCM线性脉冲编码调制这两个名词不多见,但不是什么新技术。数字化音频传输使用PCM和LPCM技术已经很多年了。主流的数字音频,无论WAV,CD等等常规音乐,都是用PCM和LPCM编码存储和还原播放的。其他MP3、wma等压缩格式,也是先解码为PCM信号再播放的。

LPCM是无损非压缩编码,支持多声道。

Dolby Digital杜比数字:

Dolby Digital既是杜比公司的一个注册商标,也是一种音频技术标准。显然,它归杜比实验室公司所有。杜比技术的演化可以追溯到1965年,当然那时是模拟信号时代。经过半个世纪的不断演化,杜比拥有几百项有关声学的专利技术。目前最新的DD Atmos(杜比全景声)技术已经进入到各个商业影院,家庭影院也在迅速铺开。除了最新的DD Atmos,目前已经在家庭影院上广泛普及的方案是Dolby Digital(杜比数字)。当然杜比数字方案内也是包含很多种子标准的,想学习的话,可以百度。目前只要知道电影类主要采用AC-3,游戏机主要采用ProLogicII两种模式就行了。(PS,除了Atmos 以前的各种杜比技术都不是无损编码的。因为DD技术的诞生主要受电影胶片存储音频限制,后续数字化技术虽然没有这个问题了,但是由于对老版技术的兼容要求,所以一直没能完全放开手脚,直到最新的Atmos标准。)

DTS数字影院系统:

看名字数字影院系统,可能有人觉得它包含视频?其实不是,DTS也是音频技术。如同DD杜比一样,DTS体系内页包含很多个子版本,但是所不同的是,DTS生来就是完全数字化,且没有存储限制问题的。所以DTS所有版本技术都支持数字无损高码流的。对标杜比全景声,DTS的最新技术叫DTS:X。

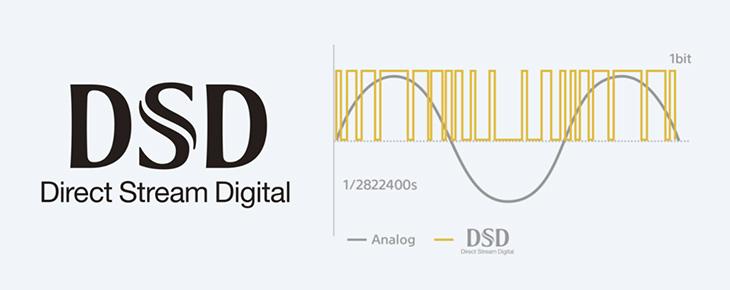

DSD:

DSD是Direct Stream Digital的缩写,表示直接比特流数字编码,是SONY为Super Audio CD发展的高解析数字音响规格。它具体算法实现对大多数人理解无意义。相对于上文提到的PCM编码方式,其特点是量化噪音处理方面性能优异,具有超高的信噪比(并不是说DSD的播放效果就一定高于传统的LPCM)。 但是DSD技术并不普及,只有少数的音乐CD采用这种技术。因为它也有很坑的硬伤,就是无法进行后期混音。音乐制作方必须先用高解析度PCM母带完成所有制作工序,再最后转换为DSD格式制作音乐CD。如果用DSD技术直录音频,要想对它做任何处理,必须翻录为PCM以后再进行。很有脱了裤子放屁的感脚。

HD/FHD/UHD/4K:

这几缩写个词,可能有各种语义解释,但是在本文里HD肯定不是指血液透析,也不是指一种摩托车。除了标题上写的HD/FHD/UHD以外,还有qHD、QHD(这俩货不一样)。其实这些概念大多是厂商炒作出来的。一开始原本就一个HD标准,就是 High Definition的缩写。翻译过来就是一个简单的词“高清”。这个标准是给显示设备(屏幕)用的。这里的标准就是“1920 x 1080p@60”。注意这是三个指标,一是分辨率1920×1080,二是刷新率60hz,三是逐行扫描p。这几个点缺一个都不算是高清标准屏幕。但是早年间很多设备制造商造不出来,或者买不起高清标准的屏幕,怎么办?大家都在说高清,我造的这1280×720的咋办?还有960×540的咋办?我怎么能跟HD挂上边呢?算了,我就说我720p的叫高清!我给540p的叫个qHD(Quarter四分之一)吧。由于大量的商家这样乱搞,搞到最后人家HD标准反倒没人清楚了。那原本的“1920 x 1080p@60”怎么办?最后给了人家一个新名字 Full HD(全高清)。后来进入4K(3840×2160)时代了,于是新名字UltraHD(超清)出现了。同时又搞出一个2K概念,2560×1440正好是1280×720的四倍大小,所以这玩意又叫了QuadHD。qHD和QHD就这么来的。好吧咱不较这个真了,就按他们说的叫吧。目前买电视或者显示器,4K有必要吗?这东西买新不买旧,如果预算充足,还是买中档4K合适,毕竟时代在发展嘛。但是如果预算比较少,买FHD也是不错的。实际在客厅观看4K跟1080p的体验差不多的,而且4K片源又很少。

HDMI/DisplayPort:

这两个东西都是高清多媒体接口。同时传输高清的音频和视频,并且支持信号回传。HDMI还可以承载TCP/IP网络。这俩技术不用纠结选择,有啥就用啥。现在的电视、功放HDMI一定不会少,各种播放机,游戏主机都有HDMI,普及率超高。在电脑上,DP接口现在也越来越多。HDMI现在是2.0标准,DP是1.4标准。(HDMI2.1已经发布,但是设备普及要等几年)

说到底HDMI还是最稳妥的选择。播放机到功放,功放到屏幕都用HDMI连接是没问题的。

HDR和色域:

这俩概念放一起说,而且值得大篇幅好好说说。这里就不用太多灰色的技术条款来说了,需要了解具体数据和原理的,请移步百度谷歌。

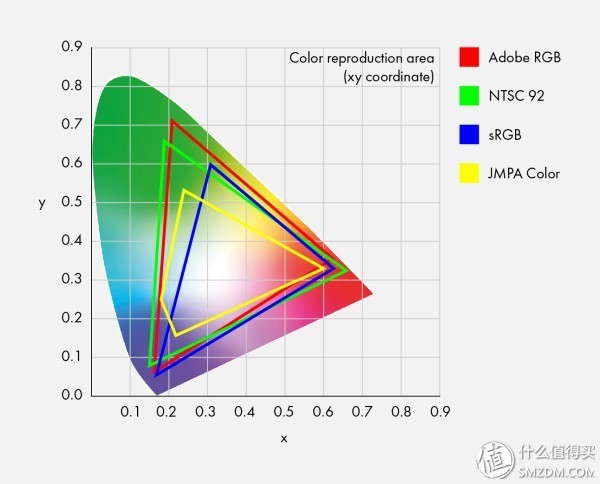

色域和HDR是一对相关的概念。这里主要让各位明白这俩概念是啥意思,干嘛用的。咱们自然界的颜色或明或暗,或红或绿,理论上是有无穷多的。但是数字图像总不能提供无限的颜色。所以在数字图像上,只能提供有限数量的颜色。这些颜色用红绿蓝(不是说红黄蓝是三原色吗?红黄蓝是色彩的三原色。这里说的是色光三原色,红绿蓝。为什么?请自行百度光的反射和吸收谱。请抢答:你直到印刷行业的四基色是啥吗?)的不同强弱组合出各种颜色。每种颜色256级正好一个字节,8位。而三个字节24位正好描述一个像素点的颜色结果。我们称之为24位真彩色TureColor。24位可以描述1670万种颜色。这里是可以描述这么多种颜色,但是显示屏没法真的显示这么多颜色,一方面是受电子元件的物理性质影响,一方面是成本限制,显示屏上每个像素色点没法都做到256级亮度,很多低端显示器只有64级。一个高档显示器能显示1400万种颜色就已经了不起,也贵死了。好在人眼也只能分辨不到1400万种颜色(大多普通人只能分辨不到1000万颜色)。这就给制造商提供了一个机会,它只需要尽可能的覆盖到人眼敏感的色彩范围就行了。色域就是描述一种色彩范围的概念。色域有NTSC、sRBG、Adobe RGB(这个主要在印刷领域)几种标准。它们不管哪个标准,大体的色彩范围是重合的,但不完全一致。 一般稍好的液晶显示器(PC使用的)色域覆盖在72%或以上有限。而液晶电视的色域覆盖普遍比电脑显示器低,大约45%以上。液晶电视跟电脑显示器的用途不同,所以设计目标也不同,虽然电视的色域比较惨,但是亮度和动态对比度比显示器高的多。

小提示,电视卖场看到的电视画面都挺鲜艳靓丽的?那是因为卖场的电视已经把亮度和对比度,饱和度都调到最高了。这种亮度在家看要闪瞎眼的。卖场的环境照明很强,所以不觉得电视特别刺眼。而且他们用来演示的视频也是专门处理过的,看似色彩多样饱满的图像,实际是精调过的,每种颜色刚好处在它屏幕的色域覆盖范围上,且很少出现大量高速运动画面。

回到色域的问题上,既然颜色数少了,那么有什么后果呢?就是相近的颜色分不清,尤其在特别暗和特别亮的部分,画面上一大块一大块的色块,根本看不清内容。可能大家都遇到过,一个图片或者视频,在电脑显示器上能看清的细节,在电视上灰糊糊一片。这个跟电视调节的亮度对比度无关,这是屏幕基础硬件设计所致。所以,不管是显示器还是电视,肯定选择色域覆盖比率更高的,动态对比更大的,效果更好。

坏消息+1:很多厂商对色域概念炒作甚至作假,比如用60%色域面板虚标72%的,甚至有些号称114%色域的无耻厂商。

简单鉴别的办法是U盘里装一部黑暗色调的高清电影短片,到卖场让商家给你播放这段视频。把屏幕亮度、对比度、饱和度都调到默认或50%以下。看你还能看清多少细节吧。

好了该说HDR了,High-Dynamic Range 高动态渲染。最近HDR技术被各大厂商采用。现在电视和显示器以及投影仪都打上了HDR的标志。但实际上HDR技术的核心是图像采集技术,起初是为拍照和录像设备提出的。无论是单反相机,还是手机摄像头,还是专业的摄像机,其内部感光元件无论是CCD还是CMOS,都有一个感光范围的问题。比如说一个感光点可以感受一种光线的强弱值,比较理想的是它能有256级,且最低感光值是0,最大感光值500。但是自然界的色彩和亮度何止256种?自然界的每个分色光线范围都可能高达几千。这0到500的256级感光器如何记录图像呢?了解摄影的朋友肯定知道光圈和快门是啥意思。OK,调节曝光参数可以使光线通量基本刚好处在感光元件的有效感应范围内。但是这对高反差的场景就力不从心了。比如画面一边是明亮的沙滩,另一边是在阴影之下。那光圈和快门该按那边调节呢?要拍清楚亮的区域,阴影里的细节就丢失了,要拍阴影里的东西,亮的一边就糊了。说到底,就是我们的感光元件无法覆盖超大的感光范围造成的。高档相机可以解决这个问题,就是采用了多重曝光技术。这正是HDR技术的前身。HDR技术诞生就是为解决高动态色彩范围问题出现的。瞬间使用不同的光圈和快门时间拍摄数十张图像,再把他们综合处理为一张图像,既保留了高亮度区域的细节,也能保留低亮度的细节,同时对颜色的记录也更精确细腻。存储HDR图像,就不是用真彩的24位数据描述一个像素了。HDR图像每个像素的一个颜色分量有1024级,使用10位存储,一个像素点至少是30位数据(深层色彩输出标准有30~48位)。30位的数据可以描述10亿多种颜色,这比之前的1670万种颜色扩充了几十倍,图像的细腻程度提高也是巨大的。

再看一张图,对比前文那张直升飞机,可以看出色彩过度多么自然。(你并未真正看到HDR效果的图片,因为我这张照片本身不是HDR技术的,你的显示器也不太可能是HDR的。这里只是让读者明白这种差异而已。) 以上是HDR图像的采集。

但是我们回到显示屏幕上来,要想将这样的HDR图像显示到屏幕上,显然不能沿用过去传统的技术了。从信号的传输方式,到显示屏的工艺都需要改进。可喜的是HDMI和DisplayPort都支持HDR要求的10bit信号传输,所以传输现在根本不是问题。问题是显示屏,过去的液晶显示屏连1670万色都显示不全,这10亿多颜色,不是纯扯淡吗?事实上不管啥技术的显示器确实都不可能实现完全的HDR色彩显示。也是只能采用部分覆盖。但是HDR显示技术对显示器提出了更高的要求,HDR技术最低标准DisplayHDR 400也要求覆盖sRGB色域的95%以上;画面白色亮度不低于400尼特,黑色亮度必须小于0.4尼特;画质引擎必须精度10bits,显示屏驱动精度8bits。而中级标准DisplayHDR 600更加要求覆盖sRGB色域的99%;白色亮度大于600尼特,黑色亮度小于0.1尼特。高级的专业标准1000则要求白色亮度达1000尼特,黑色低于0.05尼特。按上边的标准说,一般液晶显示器摸到底线400标准的边已经几乎是能力极限了。要达到更高的标准,应该依靠OLED等新技术面板才能实现。当然即便是400标准,只要真正达到,显示效果也是很大的提升。

坏消息+1:大多数国产电视厂商的液晶HDR显示都是“假”的连最低的400标准都达不到。

H264/H265/DivX

这几个名词(还有更多)都是有关视频压缩的技术。但是这几个技术并不是完全独立的,他们之间很多是相互交叉的。而目前高清电影的视频部分主要是采用H264或H265压缩编码的。一个1080p分辨率每秒24帧画面的电影,未压缩容量可能高达40~100GB,而采用H265压缩,且不损失画质的情况下,容量可缩减到6~10GB左右(再降低容量就要损失画质了)。视频解码的工作可以由CPU软件解码,也可以由CPU或GPU实现硬件解码。性能和效果存在的差异后文书再说。

Dolby Atmos和DTS:X

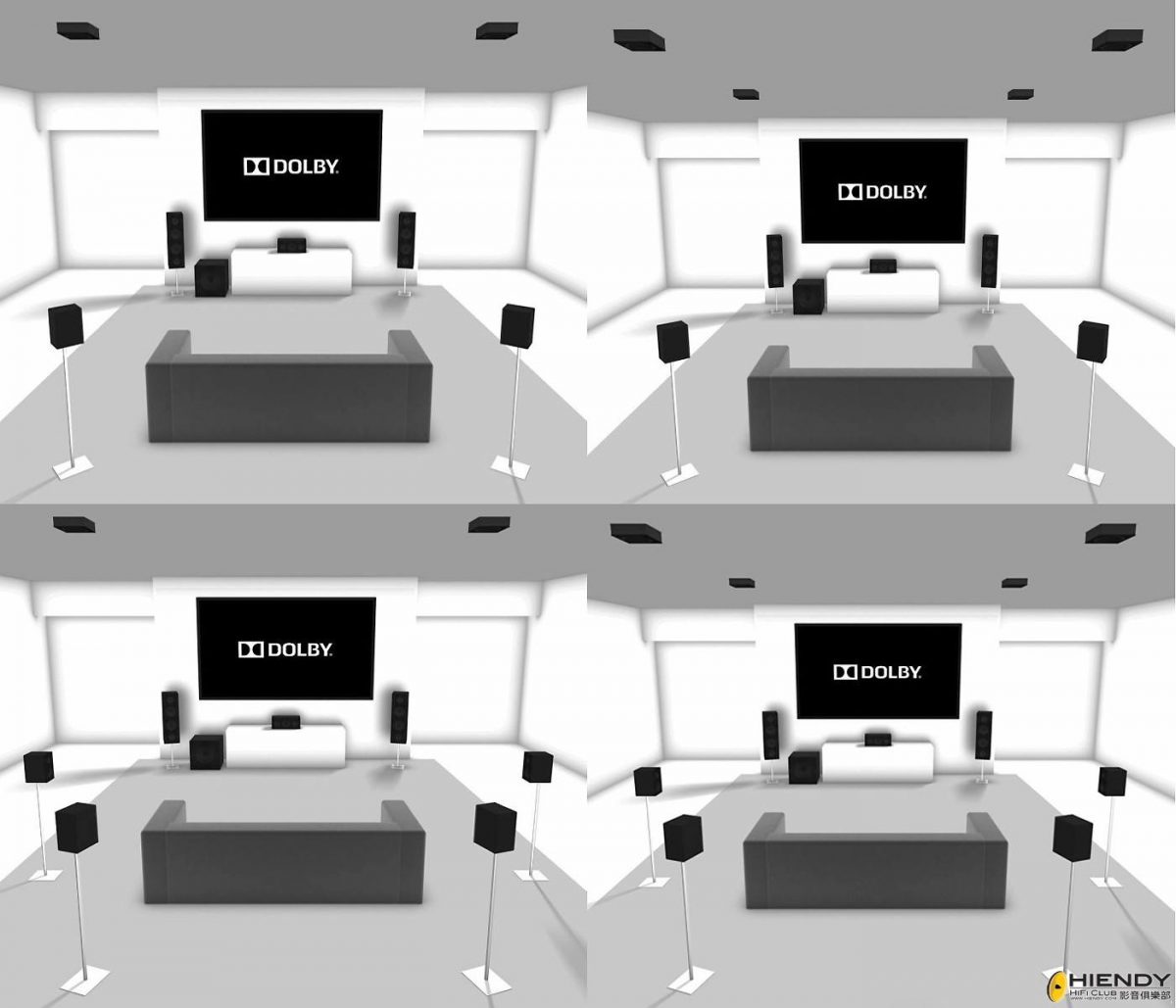

来自杜比和DTS两个音频技术大佬的两项最新技术。具体实现和原理这里不解释了,很容易百度的到。但是那些文字一般读者未必能看懂。简单来介绍一下这俩技术带来的技术变革吧。先看一下以前的环绕声播放的情况。以前的环绕声技术无论杜比家的还是DTS家的,都是采用对应的声道录制、存储和回放的。也就是说片源中存储的是什么声道,回放时也是按这几个声道来回放的,功放仅能进行有限的效果处理。比如片源中带的一套音轨是5.1声道的,包括L C R sL sR LFE,分别是左前,中置,右前,左侧,右侧,低音这六个声道,而功放解码出这些基本声道后根据播放设置能做一些简单的效果处理。比如调整前方和侧方声道的音量比例(因为每个音箱于人的距离不同)和延迟(要精确的定位声场,毫秒级的延迟也是要考虑的)。还可以根据用户选择的DSP场景进行高中低音的比例调整,回音的计算等等。如果回放设备不是5.1而是7.1的设备呢?这就比较麻烦了,因为7.1的摆放有好几种方案,可能是环形的,也可能是前方5声道(前方增加左前上和右前上),也可能是有顶置喇叭和正后方喇叭。这就需要功放根据安装调试的配置信息将5.1声道加工成7.1声道,一般主声道的左前,右前和中置是不变的,其它环绕声道会进行声音调整计算。很可能得到的结果是这样的,如果有头顶喇叭,而片源中没有顶声道,最后回放时顶喇叭是无声的。而如果有后环绕左右喇叭,而片源中没有后环绕声道,在回放时后环绕喇叭播放左右侧面喇叭相同的声音,但音量较小(音量不减小的话,会把整个声场向后拉动太多,造成声音定位的怪异感觉)。这样来看似乎功放做了很多工作啊,确实,现代数字功放解码器的功能已经很强大了。但是我们也要注意到,以上功放所作的工作是有限的,毕竟主要的声道来源就是那片源中固定好的。功放主要还是在处理一些效果上,无法改变声道位置,片源中自带的多声道已经固定了,功放无法改变声道的本质。如果片源中是7.1声道,但是它采用的是环形布局:L C R sL sR bL bR LFE,但你家里的音箱是按前5后2加低音布置的呢?或者你家里是5.1标准布局再加顶置,加正后位呢? 总不能每看一个电影就重新摆一遍音箱吧。

终于到杜比全景声和DTS:X主角登场了。这两种方案就是为了解决这种问题而来的。他们都是可以让功放根据实际情况重塑声道的。也就是说在播放的时候,根据你实际的喇叭布局,通过及时计算出一套完整的多声道音频,来最大化的利用现有的音箱,来还原一个立体的,全景的声场。它们通过音轨中存储的5~24声道全景数据,首先还原一个虚拟的球形声场,然后根据你实际拥有几个喇叭,分别在什么方向,什么距离,根据这些参数实时的计算每个喇叭应该承担什么声音,多大音量。然后让听者也能体会到一个球形全景的世界。在以前的环绕声,你可以体会到汽车从右边驶来,越来越近;也可以听出左侧后上方向正前方快速飞过的鸟群。但是这必须要求你的喇叭摆放位置与片源声道位置一致才行。位置不一致就会造成声场定位的偏移和扭曲。 有了全景声或DTS:X技术,只要你的音箱不是平面布置,而是有高低分布的情况,就可以准确的还原出立体声场。(喇叭数量越多,声场精度越精准。)未来还会增加多普勒效应的支持。